FantomXR

Keyboardmanufaktur Berlin

Hey Leute,

ich habe mich letztens gefragt, wie realistisch die Latenz-Werte, die einem der Host anzeigt, überhaupt sind. Und wie verhalten sich Interfaces untereinander?

Ich habe kurzerhand einen Test gemacht.

Angetreten ist das Focusrite 6i6 2nd Gen (199€) gegen ein Behringer UMC404HD (107€).

Getestet wurde unter 44.1kHz mit 64 Samples. Installiert wurden die neuesten Treiber. Die Tests wurden unter Windows 10 durchgeführt.

Zuerst habe ich die Latenz gemessen, die zwischen eingehendem MIDI-Signal und ausgehendem Audio-Signal entsteht.

Ich habe den MIDI Ausgang eines Keyboards an den MIDI Eingang des jeweiligen Interfaces angeschlossen. An dieses Kabel habe ich außerdem den ersten Kanal meines Oszilloskops angeschlossen. Den zweiten Kanal des Oszilloskops habe ich an den Audio-Ausgang des Interfaces angeschlossen.

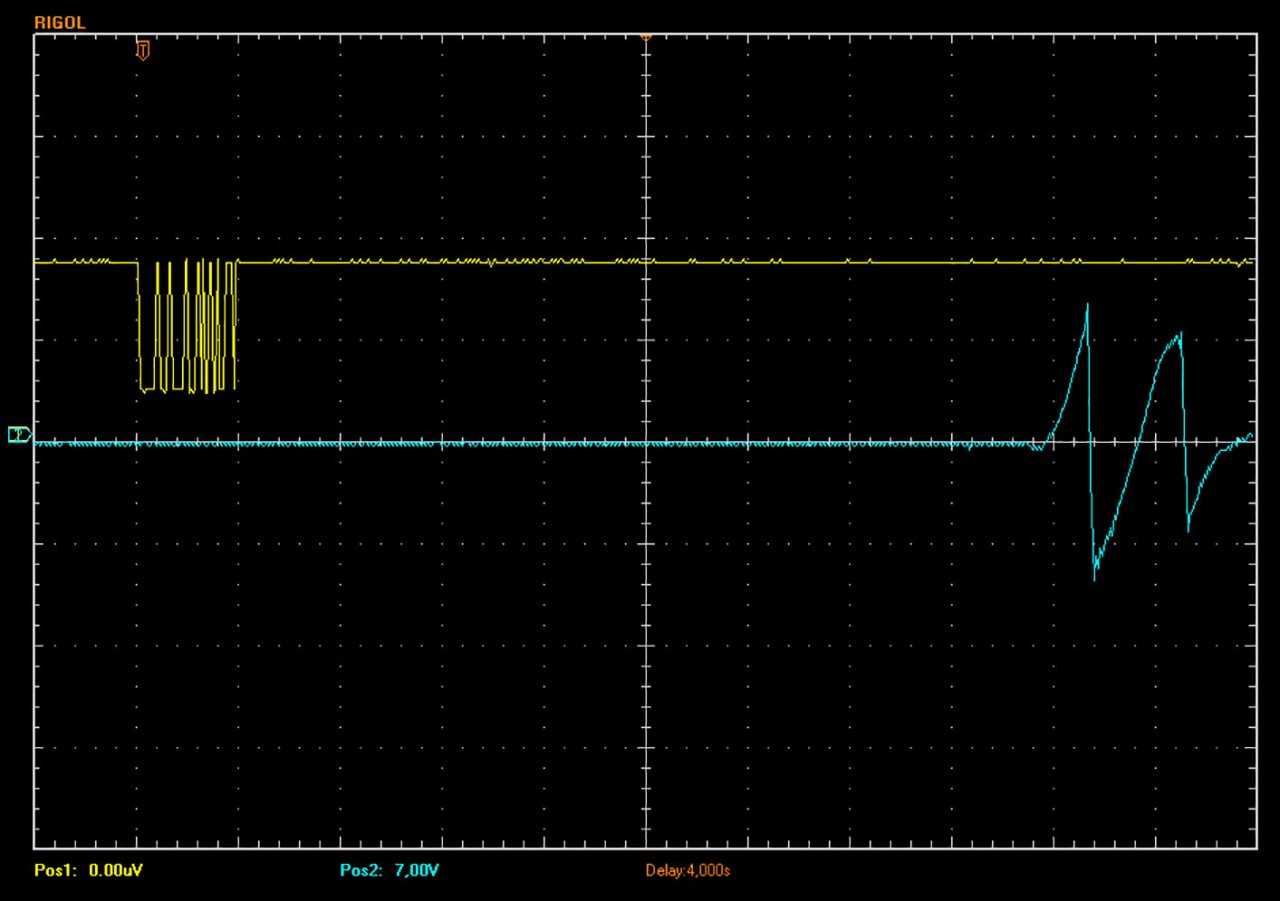

Die Ergebnisse seht ihr hier:

Focusrite:

Das Raster in der Focusrite-Messung liegt bei 1ms.

Ergebnis: Zwischen Auslösen der Taste und Erzeugung des Tons vergehen ca. 9ms

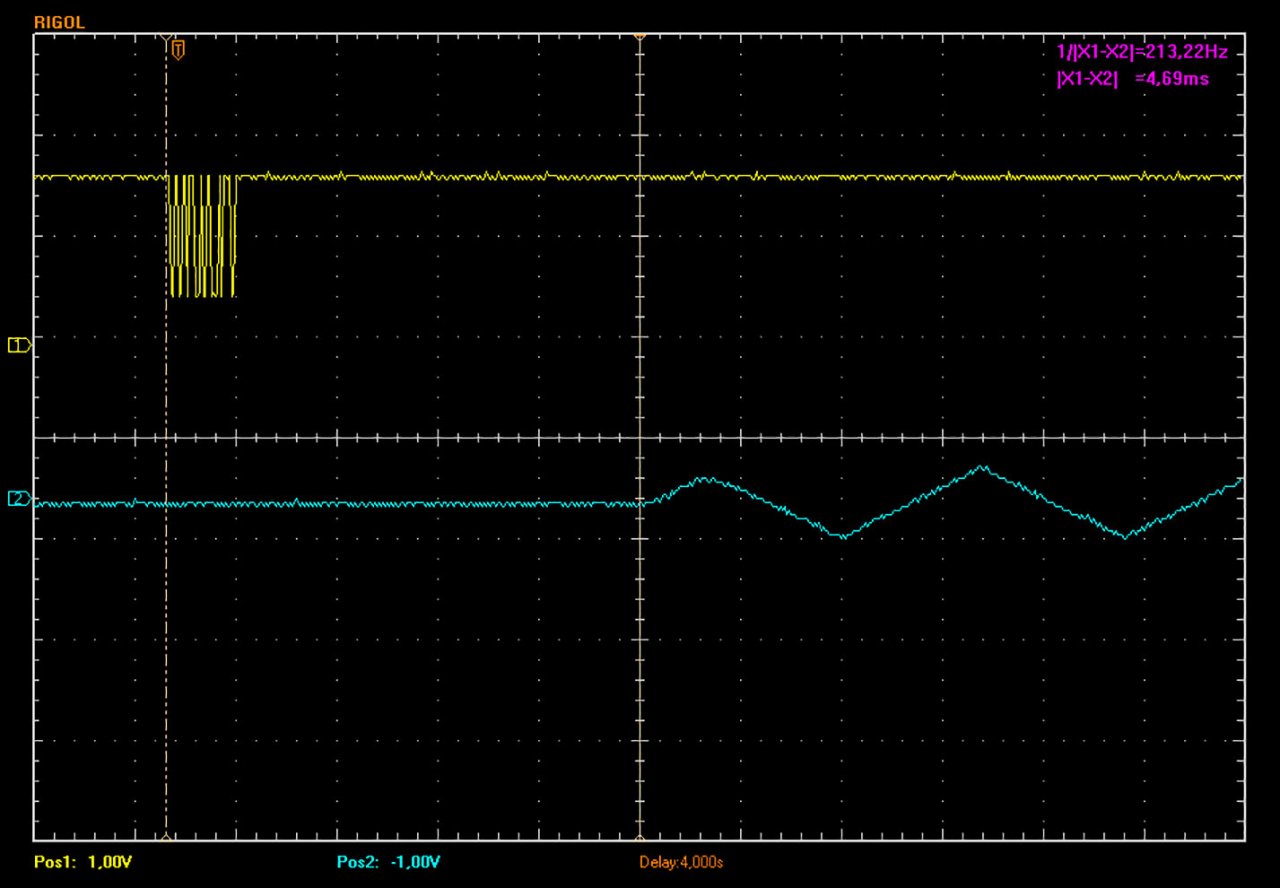

Behringer:

Das Raster in der Behringer-Messung liegt ebenfalls bei 1ms.

Ergebnis: Zwischen Auslösen der Taste und Erzeugung des Tons vergehen ca. 4.7ms.

Als zweiten Test habe ich ein Testsignal in den Audio-Eingang des Interfaces geschickt, durch einen Host geroutet und gemessen, wie lange es dauert, bis der Ton am Audio-Ausgang wieder ausgegeben wird. Die Latenz, die dabei eventuell das Programm hinzufügt, kann vernachlässigt werden, da beide Tests unter den selben Bedingungen durchgeführt wurden.

Die Ergebnisse seht ihr hier:

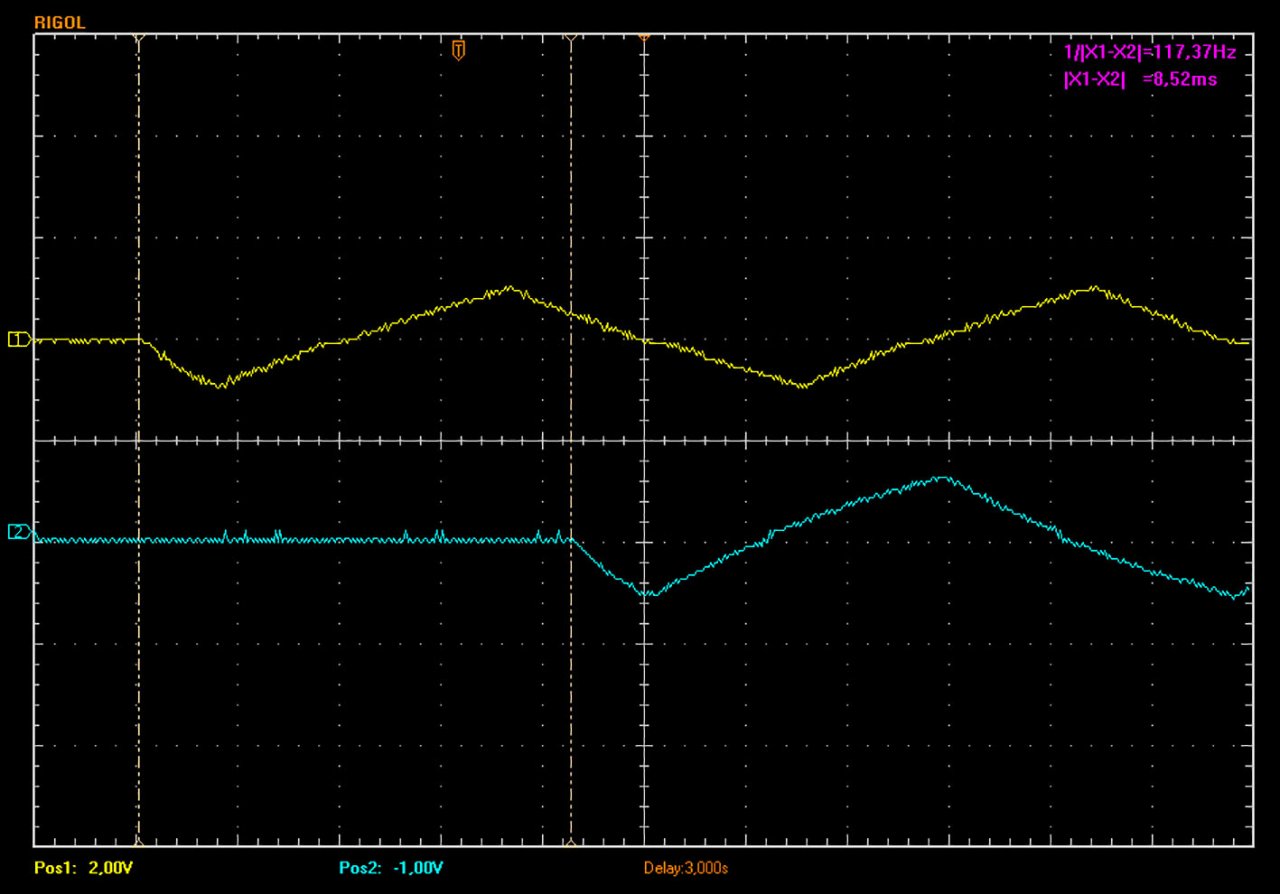

Focusrite:

Das Raster in der Focusrite-Messung liegt bei 2ms.

Ergebnis: Zwischen Eingabe und Ausgabe des Tons vergehen ca. 8,5ms

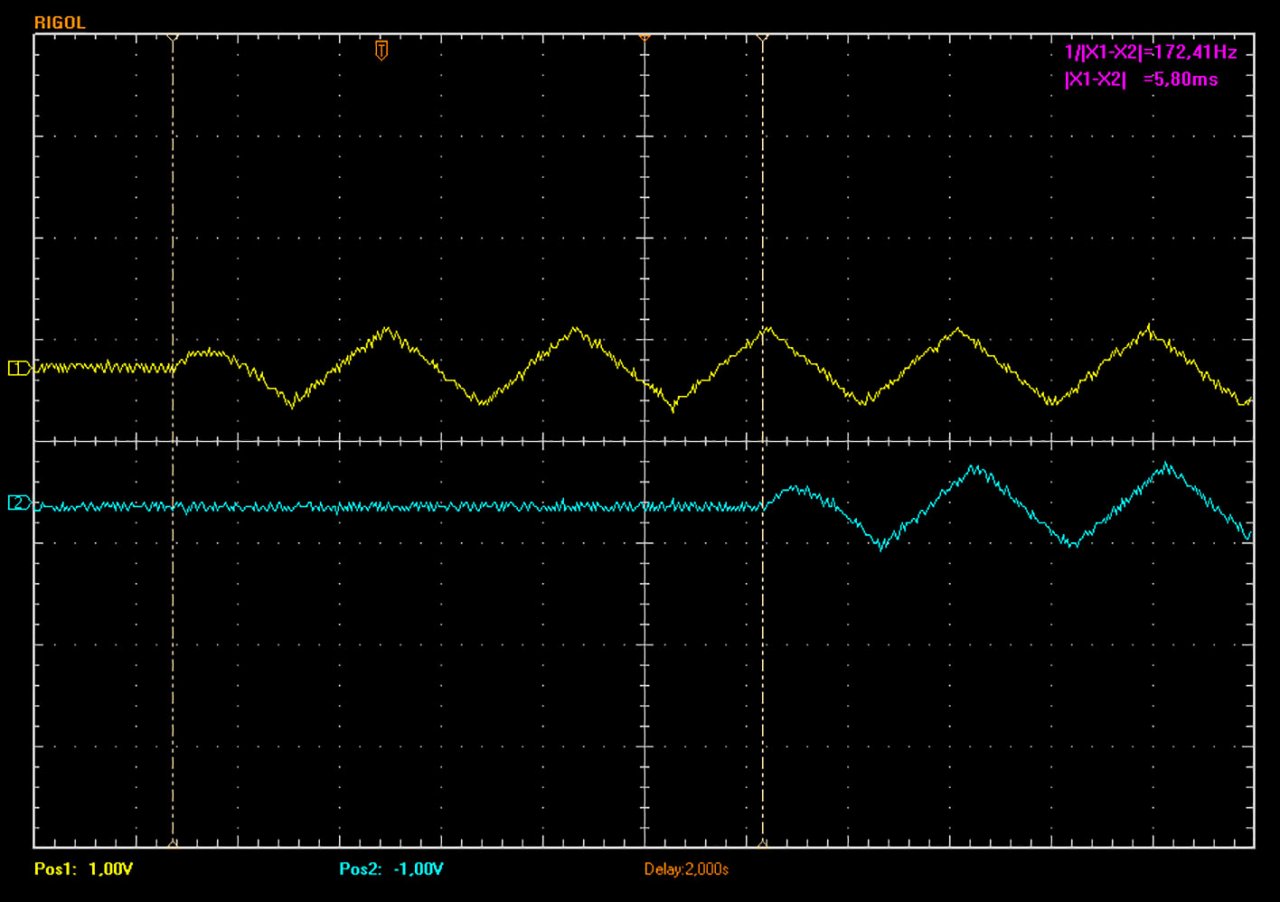

Behringer:

Das Raster in der Behringer-Messung liegt bei 1ms.

Ergebnis: Zwischen Eingabe und Ausgabe des Tons vergehen ca. 5,8ms

Die Ergebnisse haben mich doch sehr überrascht. Die DAW zeigt mir übrigens eine Latenz von 1.45ms an bei dieser Samplerate und dem Buffer. Bei dieser Angabe handelt es sich um eine Output-Latenz. Roundtrip ist üblicherweise ungefähr das doppelte also ca. 3ms. Dass dieser Wert nicht real ist, war mir vorher klar, da z.B. noch USB-Buffer hinzukommen. Auch beim Audio-In -> Audio-Out-Test ist mit zusätzlicher Latenz zu rechnen, da eine AD-Wandlung immer etwas Zeit benötigt.

Ich bin mit Focusrite im Kontakt. Dort scheint es großes Interesse an solchen Werten zu geben und man schaut sich das genauer an. Das gibt mir ein gutes Gefühl, dass dies nicht sofort abgetan wird sondern mein Anliegen erst genommen wird. Da können sich andere Firmen (wie z.B. RME) eine Scheibe von abschneiden

Morgen werde ich aber noch ein RME Babyface unter die Lupe nehmen und schauen wie es sich dort verhält. Dieser Test zeigt aber zumindest, dass man sich auf die angezeigten Werte nicht verlassen kann und sie keine Aussagekraft haben.

Was meint ihr dazu?

Leider habe ich sonst keine Interfaces mehr hier. Sonst würde ich noch einige andere in den Test einbeziehen. Vielleicht ergibt sich hier ja was.

Liebe Grüße,

Christian

ich habe mich letztens gefragt, wie realistisch die Latenz-Werte, die einem der Host anzeigt, überhaupt sind. Und wie verhalten sich Interfaces untereinander?

Ich habe kurzerhand einen Test gemacht.

Angetreten ist das Focusrite 6i6 2nd Gen (199€) gegen ein Behringer UMC404HD (107€).

Getestet wurde unter 44.1kHz mit 64 Samples. Installiert wurden die neuesten Treiber. Die Tests wurden unter Windows 10 durchgeführt.

Zuerst habe ich die Latenz gemessen, die zwischen eingehendem MIDI-Signal und ausgehendem Audio-Signal entsteht.

Ich habe den MIDI Ausgang eines Keyboards an den MIDI Eingang des jeweiligen Interfaces angeschlossen. An dieses Kabel habe ich außerdem den ersten Kanal meines Oszilloskops angeschlossen. Den zweiten Kanal des Oszilloskops habe ich an den Audio-Ausgang des Interfaces angeschlossen.

Die Ergebnisse seht ihr hier:

Focusrite:

Das Raster in der Focusrite-Messung liegt bei 1ms.

Ergebnis: Zwischen Auslösen der Taste und Erzeugung des Tons vergehen ca. 9ms

Behringer:

Das Raster in der Behringer-Messung liegt ebenfalls bei 1ms.

Ergebnis: Zwischen Auslösen der Taste und Erzeugung des Tons vergehen ca. 4.7ms.

Als zweiten Test habe ich ein Testsignal in den Audio-Eingang des Interfaces geschickt, durch einen Host geroutet und gemessen, wie lange es dauert, bis der Ton am Audio-Ausgang wieder ausgegeben wird. Die Latenz, die dabei eventuell das Programm hinzufügt, kann vernachlässigt werden, da beide Tests unter den selben Bedingungen durchgeführt wurden.

Die Ergebnisse seht ihr hier:

Focusrite:

Das Raster in der Focusrite-Messung liegt bei 2ms.

Ergebnis: Zwischen Eingabe und Ausgabe des Tons vergehen ca. 8,5ms

Behringer:

Das Raster in der Behringer-Messung liegt bei 1ms.

Ergebnis: Zwischen Eingabe und Ausgabe des Tons vergehen ca. 5,8ms

Die Ergebnisse haben mich doch sehr überrascht. Die DAW zeigt mir übrigens eine Latenz von 1.45ms an bei dieser Samplerate und dem Buffer. Bei dieser Angabe handelt es sich um eine Output-Latenz. Roundtrip ist üblicherweise ungefähr das doppelte also ca. 3ms. Dass dieser Wert nicht real ist, war mir vorher klar, da z.B. noch USB-Buffer hinzukommen. Auch beim Audio-In -> Audio-Out-Test ist mit zusätzlicher Latenz zu rechnen, da eine AD-Wandlung immer etwas Zeit benötigt.

Ich bin mit Focusrite im Kontakt. Dort scheint es großes Interesse an solchen Werten zu geben und man schaut sich das genauer an. Das gibt mir ein gutes Gefühl, dass dies nicht sofort abgetan wird sondern mein Anliegen erst genommen wird. Da können sich andere Firmen (wie z.B. RME) eine Scheibe von abschneiden

Morgen werde ich aber noch ein RME Babyface unter die Lupe nehmen und schauen wie es sich dort verhält. Dieser Test zeigt aber zumindest, dass man sich auf die angezeigten Werte nicht verlassen kann und sie keine Aussagekraft haben.

Was meint ihr dazu?

Leider habe ich sonst keine Interfaces mehr hier. Sonst würde ich noch einige andere in den Test einbeziehen. Vielleicht ergibt sich hier ja was.

Liebe Grüße,

Christian

- Eigenschaft

Natürlich bei der maximal möglichen Arbeits-Frequenz von 48 kHz und ausschließlich für digitale Audio-Schnittstellen. Welche Wandler verbaut sind, weiß der Hersteller doch Bescheid und könnte durchaus die zusätzlichen Latenzen für analoge Audio-Schnittstellen angeben. Das tut er aber nicht. Wozu? Ein Wert ist angegeben – der schönste Wert! Soll doch reichen!

Natürlich bei der maximal möglichen Arbeits-Frequenz von 48 kHz und ausschließlich für digitale Audio-Schnittstellen. Welche Wandler verbaut sind, weiß der Hersteller doch Bescheid und könnte durchaus die zusätzlichen Latenzen für analoge Audio-Schnittstellen angeben. Das tut er aber nicht. Wozu? Ein Wert ist angegeben – der schönste Wert! Soll doch reichen!