Hi Ingo,

die Sache mit dem Millioniser habe ich damals mitbekommen. Hielt aber eine 'richtige' Mundharmonika für vielversprechender hinsichtlich Ergonomie und tonale Effizienz. Und halte die noch immer für vielversprechender.

Früher dachte ich auch, die MIDI-Auflösung sei viel zu gering. Dem ist aber nicht so. Mit entsprechender Interpolation und gewissen Tricks bei den ganz niedrigen Dynamikbereichen kommt man sehr gut hin. Man benötigt mit Sicherheit keine Datenübertragung, die mehr als ein bis zwei Datenströme gleichzeitig übertragen kann. Wie willst Du in der Lage sein, drei unabhängige Luftströme gleichzeitig zu kontrollieren? Maximal hast Du ein Überblenden von einem Bereich in den nächsten. Und auch dieses Überblenden ließe sich mit minimaler Datenmenge übertragen.

Halten wir's mal quasi-gleichzeitig, weil ja alles mit serieller Datenübertragung zu steuern ist. Ich muss in der Lage sein (und bin es auch), mehrere unabhängige Luftströme (quasi)gleichzeitig zu kontrollieren. Genauer gesagt muss ich auch zwischen ihnen kontrollieren können.

Die Daten

menge ist für jeden Luftstrom die gleiche, nur die darin enthaltenen

Werte sind immer unterschiedliche. Exakt genug funktioniert das in Analoggrößen, die auf getrennten Leitungen übertragen werden. So auch quasi-exakt via Multiplexer und Demultiplexer seriell auf einer Leitung. Die Digitalübertragung sollte einer Analogsteuerung möglichst entsprechen können.

Luftdruck, Luftgeschwindigkeit, (und bei Wind Controllern á la Holz / Blech) die Ansatzposition sowie der Mundinnenraum sollten idealerweise auch gemessen und gleichzeitig übertragen werden, um den Klang zu verändern und Dinge wie Bendings zu realisieren. Da kann's dann doch etwas eng werden mit MIDI.

Die 'Dinge' lassen sich allesamt von je einer einzigen Hüllkurve steuern, wenn man sie digital hoch genug auflöst und so Schwellwerte setzen kann, die zusätzliche Effekte ins dynamische Spektrum einbauen. Die Effekte sollen dem oberhalb des Schwellwertes weiteren Verlauf der Hüllkurve folgen und dazu ihrerseits noch hinreichend Auflösung nutzen können (6 ...8 Bit).

Daher habe ich vor, OSC über über Netzwerk oder USB zu benutzen, wenn ich demnächst mit meinem eigenen (Wind) Controller Prototypen für XPression beginne. OSC wird bereits von einigen neuen Herstellern, wie z.B. Eigenharp unterstütz. Die Netzwerkübertragung erlaubt theoretisch eine 30-fache Übertragungsgeschwindigkeit. Diese wird aber durch die Netzwerkprotokolle entsprechend reduziert, hauptsächlich zur Fehlerkorrektur. Hier gibt es allerdings keinen wirklichen Standard wie bei MIDI. Jeder macht da, was er will.

Es liegen ja die unterschiedlichsten Primär-Anwendungen vor, die auf einer gemeinsamen Basis nicht gleichermaßen optimal funktionieren können. Ich meine, für jede Instrument-Gattung sollte die Interface-Basis eine eigene spezifizierte sein. Ein universell verwendbares Soundmodul/-system sollte so konstruiert sein, dass man verschiedene Interfaces einsetzen kann. So bspw. wäre die Midi-Funktion als Einschubmodul sinnvoller. Kommt das Controller-Instrument mit einem anderen Interface daher, zieht man das Midi-Interface heraus und steckt das andere Interface rein. Das (Hardware-) Soundmodul ist so auch preiswerter herstellbar und das Interface wird einfach in die Kosten des jeweiligen Controller-Instruments eingepreist.

Das Problem, das ich bei Deinem Instrument sehe, ist dass Du nicht nur einen Harmonika-Controller konstruieren musst, sondern auch ein Soundmodul / virtuelles Instrument, das Deine Daten umsetzen kann. Ich arbeite jetzt schon 6 Jahre fulltime an XPression und bin immer noch nicht wirklich da, wo ich gerne sein möchte. Einen Tonerzeuger zu bauen, der auf die Nuancen, die Du ansprichst, korrekt reagiert, wird nicht einfach werden. Alles in allem kannst Du von 5-10 Jahren Entwicklungszeit für beides ausgehen, wenn Du Deinen Job jetzt kündigst. Ob's Dir gelingt, dass alles funktioniert, weiss man vorher nicht. Du wirst auf jeden Fall auf einen sehr kleinen Markt treffen, der die Entwicklungskosten in keinem Fall rechtfertigen wird :-(

Der (primäre) Harmonika-Controller ist bereits konstruiert. Jedwede Daten umsetzen kann potenziell jedes Soundmodul. Es bedarf hier lediglich des geeigneten Interfaces. In den bisher erhältlichen Tonerzeugungsgeräten ist leider kein Zugriff auf die eigentliche Tonerzeugung möglich, weil die mit dem Midi-Interface zusammen quasi monolithisch verbaut ist. Die getrennte Applikation der Funktionsabteilungen wäre das Maß der Dinge. Jede Funktionsabteilung ein autarkes Modul.

Nicht auf jeden Fall werde ich einen sehr kleinen Markt treffen. Nur schlimmstenfalls. Entwicklungskosten sind immer zu rechtfertigen, wenn daraus ein Gebrauchsprodukt entstehen soll. Wo immer man zuerst die Kosten sieht, kann man auch jede Idee vergessen und sich mit Däumchen drehen das Leben versüßen.

Es gibt etliche Threads mit Leuten, die Controller-Instrumente in irgend einer Form bauen wollen. Fast keiner schafft es, einen funktionierenden Prototypen herzustellen, geschweige denn, die Instrumente in Serie zu bringen.

Das ständige Polemisieren, dass alles was auf dem Markt ist nichts taugt, bringt nur was, wenn man tatsächlich etwas Besseres zustande bringt. Ich warte selbst schon seit etlichen Jahren darauf, dass sich etwas tut. Leider vergebens!

Neue Controller-Instrumente in Serie gehen mit der obligatorischen Orientierung am Midi-Standard einher. Die Industrie sagt nein, wo Midi nicht mitspielt. Marketing. Midi kann aber nicht alles, und so bleibt mancher auf seinen Projekten sitzen. Besseres zustande bringen lässt sich am ehesten, indem auch die Industrie Kompromisse eingeht und eine Möglichkeit gemäß meinem obigen Konzept annimmt.

In der Regel gehen die meisten, wie Du auch, von theoretischen Idealen aus, die weder technisch noch musikalisch sinnvoll sind. Geschwindigkeit bei der Datenübertragung wird völlig überschätzt. Das was zählt, ist die Qualität der Auswertung und das korrekte Mapping auf die Klangparameter des Tonerzeugers. Kaum ein aktuelles Instrument kann mit solchen Daten etwas anfangen.

Es geht mir nicht um theoretische Ideale, sondern um technisch realisierbare Möglichkeiten, die vor allem musikalisch sinnvoll sind. Das Gegenteil würde ich sofort verwerfen!

Die Geschwindigkeit der Datenübertragung muss so hoch sein, dass die Arbeitsfrequenz der stetigen Dynamik-Aktualisierung nicht aus den Tönen herausgehört werden kann. Es sei denn, eine Sample&Hold-Funktion pendelt die Aktualisierungen unter 20 Hz ein. Das bedeutet aber mindestens 50 ms Verzögerung; ob sich das evt. störend auswirkt, kann nur die Praxis herausstellen.

Noch ein kurzer Nachtrag ...

... ich habe eben mal recherchiert, was Airflow Sensoren zur Messung der Luftgeschwindigkeit kosten. Diese wären zusätzlich zu den günstigeren Drucksensoren notwendig um Bending zu ermöglichen. Da sind wir pro Stück bei 55 - 80 Euro + Mehrwertsteuer.

Schon allein die Sensoren würden in einer Konstruktion wie Du sie vorschlägst ein kleines Vermögen kosten. Eine kommerzielle Version des Instrumentes wäre nicht unter 2.000 - 3.000 Euro VK herzustellen - wenn das überhaupt reicht. Es kommen ja noch weitere Bauteile, Herstellungskosten, Entwicklungskosten, Vertriebskosten, Werbung, etc. hinzu. Das ganze natürlich ohne Soundmodul!

Mit 16 Sensoren je 30,- DM war ich auch nicht froh. Der Preis liegt heute noch immer um 15 Euro. Aber je größer die Stückzahl, desto günstiger der Einzelpreis. Für den Fall einer Serienfertigung habe ich mir ein anderes Konzept ausgedacht. Dieses Konzept umfasst die Sensorik für alle 16 Kanzellen und dürfte in Serienfertigung den Preis eines Einzelsensors nicht wesentlich übersteigen.

Ein weiteres Problem wäre die benötigte Größe. Um solch einen Kontroller zu fertigen müsste man eine sehr durchdachte Konstruktion bauen, um den Luftdurchsatz über nur wenige zusammengeführte Sensoren zu messen. Ob sich durch die Veränderungen in den Luftkammernwegen Messungenauigkeiten einstellen, die die Intonation unbrauchbar machen, wäre noch abzuwarten.

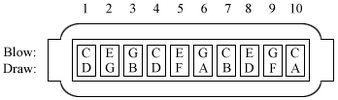

Das hast Du so nicht richtig rekonfiguriert: es gibt keine zusammengeführten Sensoren. Jeder Sensor steht in autarker Verbindung mit dem für ihn zuständigen Ton-Duo. Weil der Chromat hinzukommt, ist jeder Sensor für 4 Töne zuständig. Zwischen diesen 4 Tönen wird alterniert durch Drücken (Blasen), Ziehen (Saugen) und Chromat. Richtig erkannt hast Du, dass eine sehr durchdachte Konstruktion zu bauen ist. Das hat mich aber keineswegs in Verlegenheit gebracht. Denn nichts ist unmöglich, wenn es nur darum geht ...

Die Druckschwankungen beim Wechsel von einstimmigen zu mehrstimmigen Spiel sind mit Sicherheit auf nicht ohne.

Das hat man bisher mit der klassischen Mundharmonika im Griff gehabt. Und so wird man das auch mit der elektronischen Mundharmonika in den Griff bekommen. Mein Stadium von 1987 hat mich davon überzeugt, dass es bestens funktioniert.

Ein traditioneller Wind Controller Aufbau mit nur einem Blassensor ist deutlich einfacher in den Griff zu bekommen. So etwas kann man sich mit einem Arduino Board - wie Nyle Steiner das bereits vorgemacht hat - innerhalb von einem Tag in EWI-Qualität bauen.

Ich habe nicht die Absicht, mich auf die deutlich einfacheren Möglichkeiten zu beschränken. Denn ich will ein primär freihändig solierbares Universal-Musikinstrument realisieren. Mithin sekundär auch den Profi-Harpern die elektronische Tonerzeugung zugänglich machen. Das geht wenn auch bisweilen nur undeutlich einfach genug, um es ganz fest im Auge behalten zu können. Ein traditioneller 'Wind Controller Aufbau' darf mich einfach nicht interessieren. Weil das nur Ballast fortpflanzt, der auf dem Weg ins Geling-Ziel einer neuen Sache einfach nichts zu suchen hat.

... aber da sind wir ja wieder bei der Qualität der aktuellen Instrumente, die leider noch auf dem Stand der Technik von ca. 1980 sind. :-(

Genauer gesagt, 1983/84.

Und ich grüße Dich, Ingo, heute in 2013

Arwed