hack_meck

Lounge .&. Backstage

- Zuletzt hier

- 04.04.26

- Registriert

- 31.08.08

- Beiträge

- 39.782

- Kekse

- 509.770

- Ort

- abeam ETOU

iZotope RX9 - ein/mein Erstkontakt

Hier werde ich - aus der Sicht des Einsteigers - etwas schreiben über meinen Erstkontakt mit iZotope RX9. Gründe, sich dem Werkzeug zu nähern, haben wir sicher alle. Wie Murphy es so will, schleichen sich besonders im Heimischen - nicht (sound-)sterilem - Umfeld isolierte Störgeräusche (Pfiff, Klappern, Husten) mit auf die Aufnahme. Und es wäre nicht Murphy, wenn es nicht den spielerisch besten Take betreffen würde . Aber auch bei vielen meiner Interviews an exponierten Orten (NAMM, Factory Tours ...) hatte ich immer mal dauerhafte Überlagerungen von Maschinen, Wind oder Klimaanlagen zu beklagen, die ich jeweils versucht habe, mit einem EQ im Videoprogramm zumindest einzudämmen. Dies hat aber oft auch auf die Stimmfärbung durchgeschlagen, war also immer ein Kompromiss. Was aber, wenn man mit Unterstützung der künstlichen Intelligenz diese Geräusche "entfernen" könnte?

. Aber auch bei vielen meiner Interviews an exponierten Orten (NAMM, Factory Tours ...) hatte ich immer mal dauerhafte Überlagerungen von Maschinen, Wind oder Klimaanlagen zu beklagen, die ich jeweils versucht habe, mit einem EQ im Videoprogramm zumindest einzudämmen. Dies hat aber oft auch auf die Stimmfärbung durchgeschlagen, war also immer ein Kompromiss. Was aber, wenn man mit Unterstützung der künstlichen Intelligenz diese Geräusche "entfernen" könnte?

iZotope RX ist primär ein Werkzeug für Profis, denn der Aufwand eine Tonspur zu retten, ist immer günstiger als einen Drehtag am Set zu wiederholen. Aber iZotope nimmt für sich in Anspruch, auch dem Neueinsteiger den Zugang durch ihre intelligenten Presets zu erleichtern. So viel vorweg - gefunden habe ich die Probleme in meiner Testdatei recht leicht. Um sinnvolle Markierungen zu machen und die richtigen Werkzeuge auszuwählen, musste ich mir etwas Hilfe holen. Aber dazu später mehr.

Meinen eigentlichen Erstkontakt zu iZotope RX hatte ich auf der Gearhead University bei Thomann. Schon damals empfand ich die optische Darstellung der in den verschiedenen Frequenzbereichen vorhandenen Energie als sehr interessant, da es deutlich besser als die Wellenform zeigt, was da in einem Segment der Tonspur eigentlich los ist.

Was ist RX?

Der Denkansatz hinter RX ist, einen technischen Vorgang in einen kreativen zu wandeln. Hä? Hinter der Aussage stehen für mich 3 Kernelemente.

Time is Money gilt zwar nicht unbedingt für uns Hobbyisten, aber im Haupteinsatzgebiet von RX (Film und Fernsehen) zählt jede Minute. Und so gibt es auch ein Paket an Werkzeugen, die im Prinzip jeder Tonspur guttun. De-Noise (Netzbrummen und Co.), De-Click und Mouth De-Click sind dabei die GoTo Werkzeuge der Profis. Die Berechnung der Vorschau wird dabei recht zügig erledigt. (ein 5 Minuten iPhone Interview war auf meinem iMac von 2013 - 32 GB RAM - in 30 Sekunden berechnet).

Neben der Stimme wurde RX im Rahmen des Machine Learning auch beigebracht, wie einige Instrumente klingen und zu isolieren sind. Das Tool Music Rebalance erlaubt es dann diese Instrumente anzuheben oder abzusenken. Ihr werdet jetzt sagen ... "hhhmm, RX ist also ein Werkzeug um den Fehler im Mix zu beheben? Warum nicht gleich einen guten Mix anlegen?" Und richtig, liegen die Einzelspuren vor, so sollte dieses Problem gar nicht erst auftauchen. Allerdings haben wir mit unserer Band grade die Situation durchlaufen, dass wir im Rahmen einer kleinen Video Session mit fertigem Mix von der Bühne gespielt haben. Dieser war für die anwesenden Ohren auch wirklich gut, das Stereo Mikro Paar der Videokamera hat jedoch etwas anderes wahrgenommen (etwas analytisch und weitestgehend ohne Raum). Die Tonspur klang etwas ernüchternd ... Ein ähnliches Werkzeug ist auch Bestandteil von iZotope Ozone. Als "Master Relance" hat es uns bei der Pegelkorrektur von Drums, Vocals und Bass innerhalb des fertigen Mix gute Dienste geleistet. Es arbeitet dort in Echtzeit und kann automatisiert werden. (P.S. Zu Ozone plane ich einen weiteren Newbee Thread).

Der Erstkontakt bei der Thomann Gearhead (RX7)

Mein Spieltrieb (RX9)

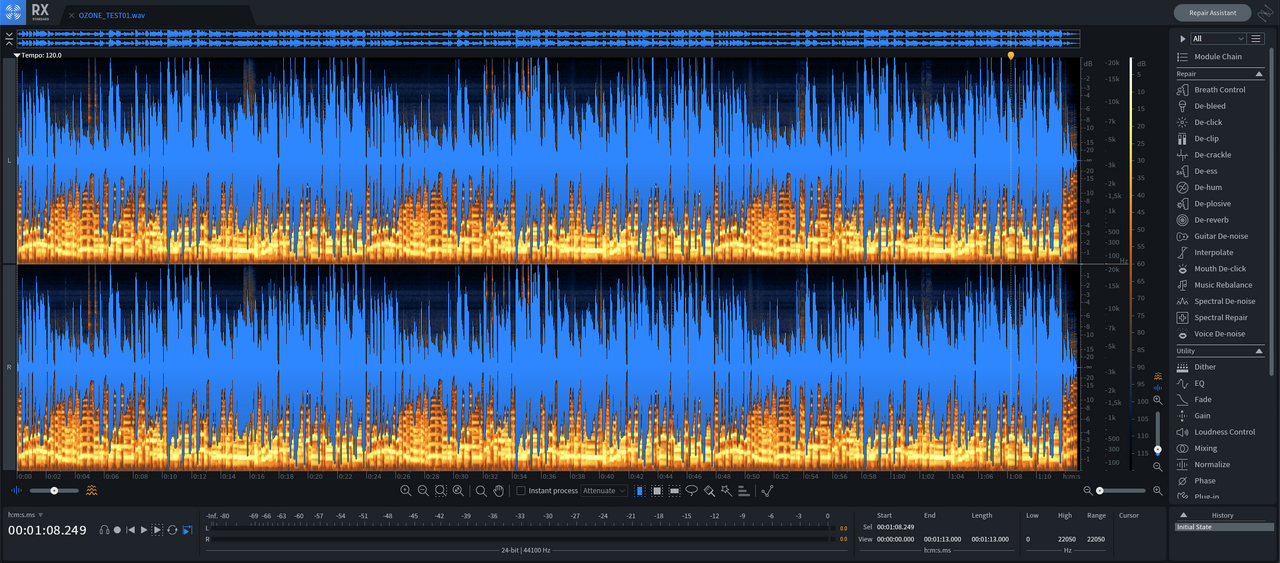

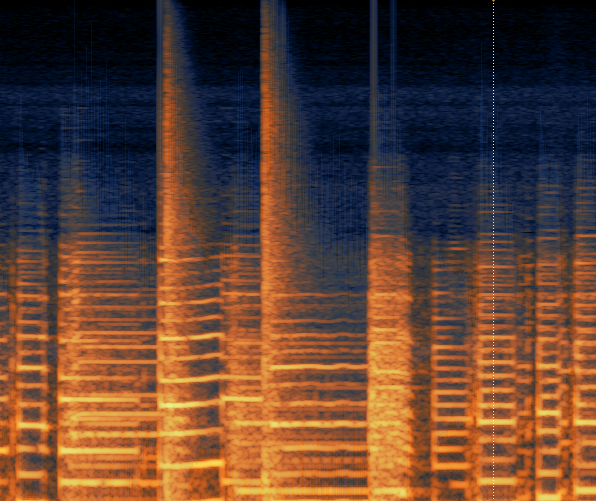

Durch die Möglichkeiten von iZotope Ozone neugierig geworden, habe ich mich auch an meinen RX Kontakt erinnert. Der Spieltrieb war geweckt und ich habe mir zwei Gitarrenspuren in den Looper gespielt und dann davon eine Aufnahme mit Störgeräuschen erstellt. Geklappert, gehustet und einiges mehr. Jetzt wollte ich wissen, wie weit ich diese Störgeräusche wieder entfernen kann. Wie ich recht schnell bemerkt habe, hatte ich zumindest einen kleinen Vorteil durch die Verwendung eines Guitar Cabinets als Quelle. Alle Störgeräusche hatten Obertöne, die über dem Gitarrensignal angesiedelt waren. In der bildlichen Darstellung konnte ich so zumindest die Stellen sehr gut identifizieren. Aber auch die Störungen waren - weil intensiver als das Hauptmaterial recht gut zu sehen. Durch die viele Energie an genau einer Stelle, springen sie einem fast ins Auge.

Anmerkung:

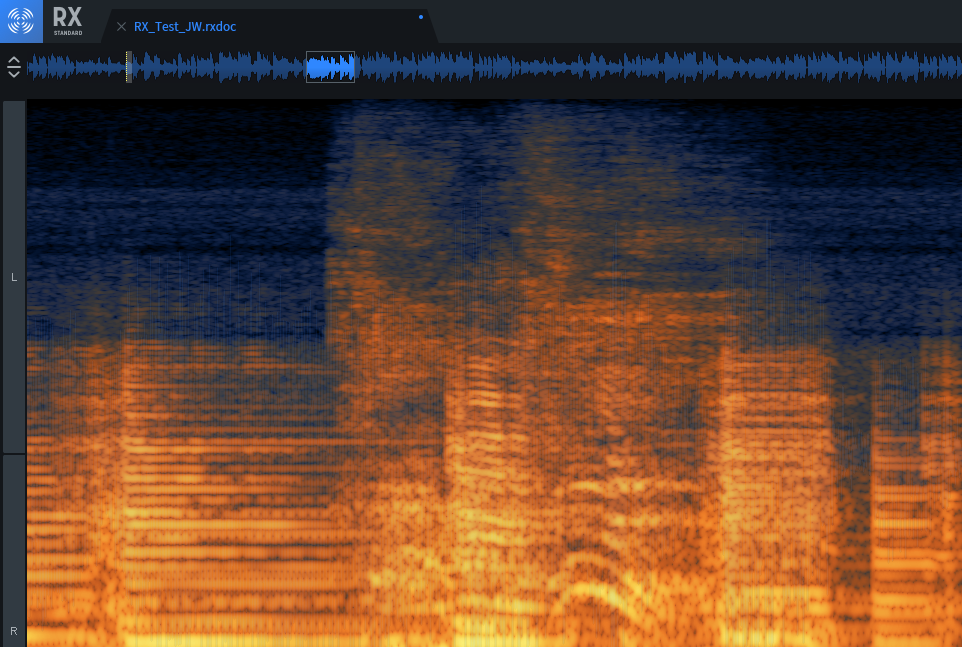

blau - die normale Wave Form

orange - zeigt die Energieverteilung nach Frequenzen. Unten die tiefen Frequenzen, oben die hohen Frequenzen. Je heller - desto mehr Energie ...

...

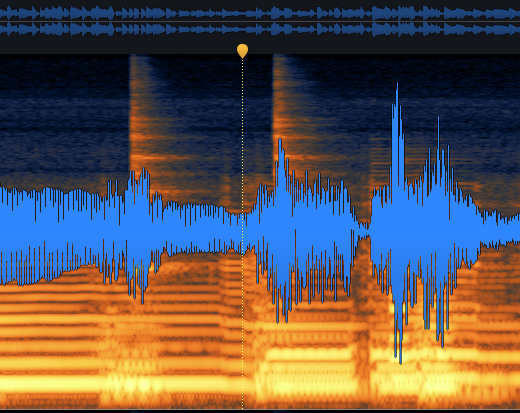

Für die weiter Betrachtung schalte ich das Wave-Overlay aus. Aber bereits hier sieht man gut, dass nur meine beiden Störgeräusche - mit denen ich mich zuerst befassen will - oben herum "Energie" produzieren.

Fehler #1 - die Klicks

Hier das Missgeschick ... zwar im Takt, aber trotzdem fehl am Platz. P.S. Störgeräusche die im Takt liegen, sind oft etwas schwerer zu erreichen.

Mehr Probleme hatte ich beim Markieren die Stellen so zu erwischen, dass ich auch alles ausgeblendet bekomme. Wie sich im Nachgang rausstellte, habe ich zu wenig Fleisch gelassen und mich zu sehr auf die Teilbereiche hoher Intensität beschränkt. Das hatte zur Folge, dass zwar das Hauptgeräusch entfernt war, der hörbare Eindruck eines "klicks" jedoch noch zu erkennen war. So, als hätte ich die Schatten nicht "(v)erwischt". Ein zweites Thema bei meinem Trial & Error war, dass ich jeweils versucht habe, mit einem Durchgang zu arbeiten. Im Dialog mit Jürgen (oben aus dem Video) hat er mir mit seiner Herangehensweise eine Variante gezeigt, die auf mehreren Schichten basiert, in denen das fehlerhafte Material abgetragen wird und gleichzeitig aus der Umgebung der Markierung Ersatz hinzugefügt wird.

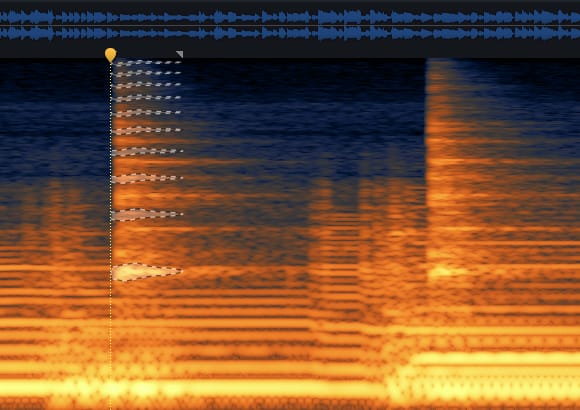

Wie man hier sehen kann, habe ich den Grundton des Klicks gut gefunden und über die RX Software - ähnlich wie beim Pfeifen im Beispiel des Gearhead Videos - die Obertöne dazu anzeigen lassen. Wie bereits erwähnt, hat dieser Weg zwar Wirkung gezeigt, aber nicht abschließend dazu geführt den Klick komplett zu entfernen.

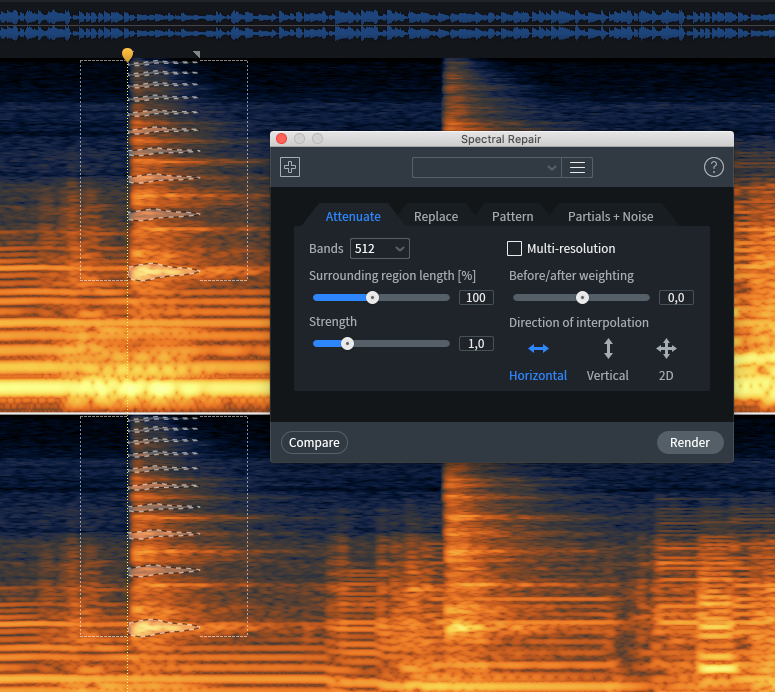

Jürgen hat dann empfohlen etwas großzügiger zu markieren (entweder so filigran wie hier, oder über ein Rechteck der kompletten Stelle ab dem Grundton des Klicks.) Da im Werkzeug "Spectral Repair" sowieso ein Parameter für die "Surrounding region lenght" angelegt werden kann, schaut die Software auch ausserhalb der Markierung. Innerhalb der Markierung kann man mit "Strenght" wählen ab welcher Schwelle die Reparatur zur Anwendung kommt.

Durch eine Kombination aus "Attenuate" (Absenkung des gewählten Materiales) und "Replace" (Ersetzung des gewählten Materiales) sind wir der Aufgabe #1 Herr geworden und haben die beiden Klicks aus dem Track entfernen können. Geschätzter Zeitaufwand von Datei öffnen, Stelle finden, markieren, ein wenig probieren und Ergebnis exportieren - ohne erklärendes Gelaber, wenn man das Programm beherrscht - unter 3 min.

Hier nun das Ergebnis dieser Stelle in der Schnellbearbeitung ...

Fehler #2 - Husten, we have a problem

War ja klar, der stört auch noch an einer Stelle. Hier erst mal der entsprechende Ausschnitt. Befasst haben wir uns mit der ersten Hälfte. Wenn ihr hinhört, klingt mein Hustenanfall wie 2 Silben.

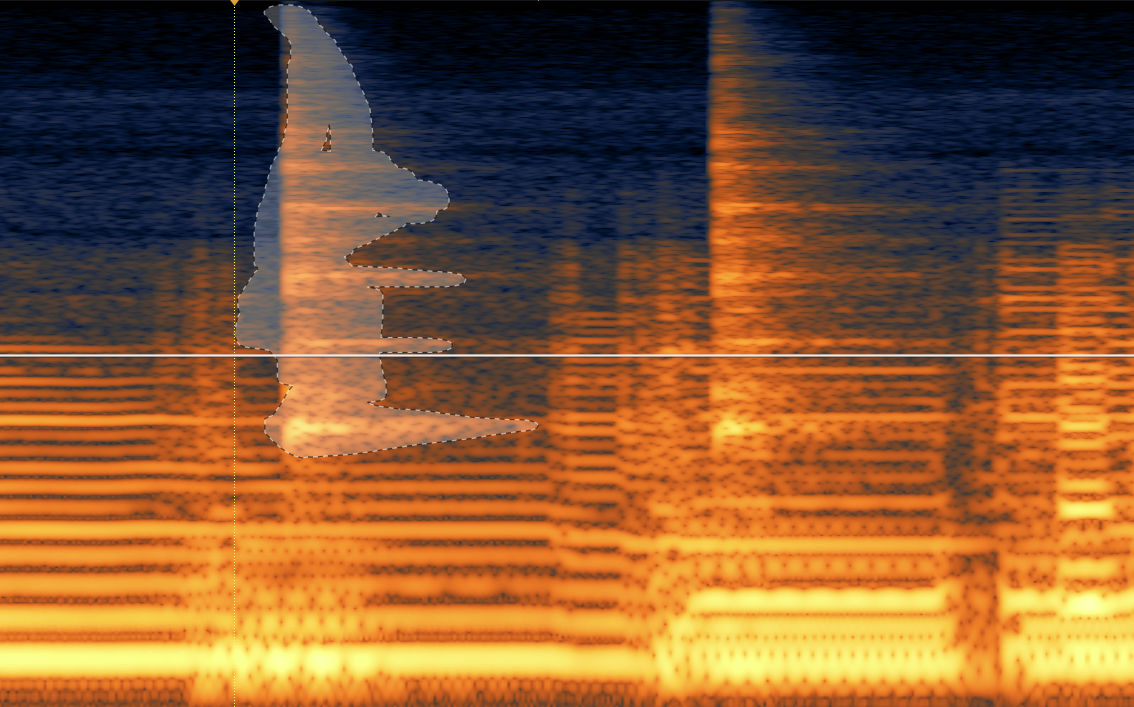

Das sieht dann in der Heatmap so aus ...

Die Teile oben lassen sich recht einfach beschneiden, aber so ein Husten sitzt ja bekanntlich tief. Daher gibt es auch innerhalb der "Nutzinformation" was anzufassen. Ganz leicht ist es nicht den komplett weg zu bekommen, aber zumindest soweit gedämpft, dass er nicht mehr auffällt.

Als Werkzeuge waren wieder Attenuate und Replace am Start.

Bitte beachtet, wie der untere helle Fleck an "Wucht" verliert ...

Diesmal erkennt man es sogar in der WAVE Form, der die Spitze der "ersten Silbe" gekappt wurde. (Siehe Markierung im Vergleich zur oberen Spur die korrigiert ist).

Hier also das Soundschnipsel ohne den ersten Teil des Hustens.

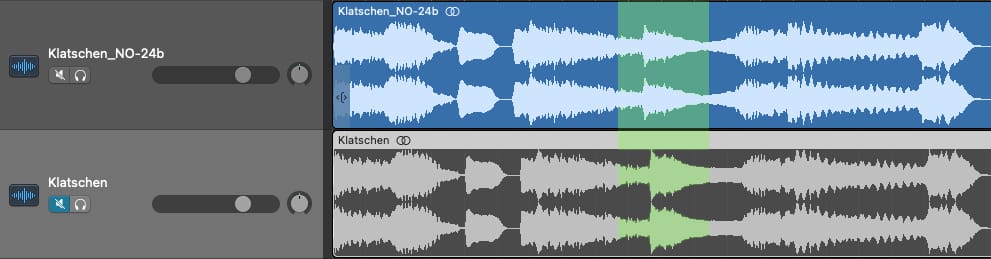

Fehler #3 Klatschen

Vom Pegel in der WAVE-Form passte das Klatschen ganz gut zur restlichen Information, daher ist auch kein wesentlicher Unterschied vorher/nachher zu sehen. Es passierte in der markierten Stelle.

Auch hier gab es wieder etwas mehr zu markieren und besonders in diesem Fall wurde auch nicht alles in einem "Rutsch" gemacht.

Fehler #4 Reverb auf Interviewstimme

Dies ein Beispiel welches iZotope mal vorbereitet hatte. Es ist Teil des Pressepaket.

Vorher

Nach der Korrektur ...

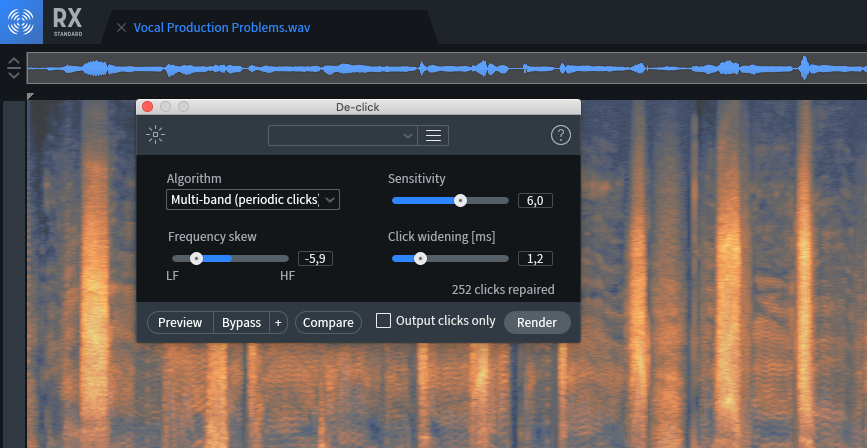

Fehler #5 De-Click

Wieder basierend auf einer WAV Datei von iZotope habe ich diesmal selbst probiert was im De-Click Werkzeug drin steckt. Bei dieser Aufnahme hat sich ein recht konstantes Klicken im Hintergrund eingeschlichen. Man hört es nicht direkt prominent, aber wehe man hat es mal gehört ...

...

So habe ich es probiert. Bei noch weiter erhöhter Sensitivity sagt mein Ohr "Stop", denn dann klingen auch die Vocals verwaschen. Was auch eine interessante Option ist um rauszuhören ob man tatsächlich die Störgeräusche erwischt, die man erwischen möchte, ist die Schalterstellung "Output Clicks Only". Also im Prinzip die Umkehrung - je natürlicher die Klicks hier klingen, umso besser werden sie in der Zieldatei weggelassen.

Klingt dann so.

Fazit

Es ist erstaunlich, was man an Störfaktoren aus Dateien entfernen kann. Natürlich sollte dies kein Freibrief sein, um sich bei der Aufnahme nicht mehr zu bemühen, denn zumindest als Anfänger muss man Zeit und Ausdauer zur Korrektur mitbringen. Es gibt aber wohl auch Vollprofis die an der Supermarktkasse in Bezug auf ein Bild des Geschehens mal schnell eine Reparaturkette vorschlagen. Grundsätzlich ist die Art der Visualisierung wirklich der Problemlösung förderlich. P.S. bei der Erstellung des Lava-Lampen Sounds mit Moogmann war ich das erste mal dabei, wie sich jemand rein "optisch" durch einen Soundfile bewegt und dabei passende Schnitte erledigt hat.

Auch mir gefällt mir der optische Zugang zum Material besonders gut. Was ich abschwächen muss wird so für mich deutlich intuitiver und ich brauche kein "Frequenz-Rate-Spiel" machen um zu erkennen was betroffen ist. Die vorbereiteten Werkzeuge laden zum experimentieren ein und sind sehr verständlich in der Bedienung.

In Summe war die Zeit - mit der ich mich mit dem Werkzeug beschäftigt habe - viel zu kurz, um auch nur im Ansatz den Sprung weg vom oben erwähnten Newbee zu schaffen. Da gibt es noch einiges zu lernen und auszuprobieren. Der Erfolg an den kleinen Beispielen macht aber Mut dran zu bleiben.

Primär ging es mir beim Testrun jedoch nicht darum Fachmann zu werden, sondern die Neugierde rauszufinden was als Noob überhaupt geht, war die Triebfeder. ...

...

Wenn euch der Thread neugierig gemacht hat, oder ihr bereits mehr Erfahrung mit RX besitzt, würde ich mich über kleine Berichte oder HowTo's freuen. Screenshoot der Problemstelle, vorher/nachher mp3 und ein wenig Info zu den eingesetzten Mittel aus dem RX Werkzeugkasten sind sicher wertvolle Information für Nachahmer ... Los gehts

EDIT - natürlich sind auch Video Tutorial Fundstücke gerne gesehen. Da ich ja in meinen Interview Situationen viel mit den typischen Podcaster Problemen zu tun habe, fand ich dieses Video (noch in Bezug auf RX8) recht spannend, da es einen Großteil der Probleme in die ich regelmäßig reinlaufe adressiert.

Gruß

Martin

Hier werde ich - aus der Sicht des Einsteigers - etwas schreiben über meinen Erstkontakt mit iZotope RX9. Gründe, sich dem Werkzeug zu nähern, haben wir sicher alle. Wie Murphy es so will, schleichen sich besonders im Heimischen - nicht (sound-)sterilem - Umfeld isolierte Störgeräusche (Pfiff, Klappern, Husten) mit auf die Aufnahme. Und es wäre nicht Murphy, wenn es nicht den spielerisch besten Take betreffen würde

. Aber auch bei vielen meiner Interviews an exponierten Orten (NAMM, Factory Tours ...) hatte ich immer mal dauerhafte Überlagerungen von Maschinen, Wind oder Klimaanlagen zu beklagen, die ich jeweils versucht habe, mit einem EQ im Videoprogramm zumindest einzudämmen. Dies hat aber oft auch auf die Stimmfärbung durchgeschlagen, war also immer ein Kompromiss. Was aber, wenn man mit Unterstützung der künstlichen Intelligenz diese Geräusche "entfernen" könnte?

. Aber auch bei vielen meiner Interviews an exponierten Orten (NAMM, Factory Tours ...) hatte ich immer mal dauerhafte Überlagerungen von Maschinen, Wind oder Klimaanlagen zu beklagen, die ich jeweils versucht habe, mit einem EQ im Videoprogramm zumindest einzudämmen. Dies hat aber oft auch auf die Stimmfärbung durchgeschlagen, war also immer ein Kompromiss. Was aber, wenn man mit Unterstützung der künstlichen Intelligenz diese Geräusche "entfernen" könnte?iZotope RX ist primär ein Werkzeug für Profis, denn der Aufwand eine Tonspur zu retten, ist immer günstiger als einen Drehtag am Set zu wiederholen. Aber iZotope nimmt für sich in Anspruch, auch dem Neueinsteiger den Zugang durch ihre intelligenten Presets zu erleichtern. So viel vorweg - gefunden habe ich die Probleme in meiner Testdatei recht leicht. Um sinnvolle Markierungen zu machen und die richtigen Werkzeuge auszuwählen, musste ich mir etwas Hilfe holen. Aber dazu später mehr.

Meinen eigentlichen Erstkontakt zu iZotope RX hatte ich auf der Gearhead University bei Thomann. Schon damals empfand ich die optische Darstellung der in den verschiedenen Frequenzbereichen vorhandenen Energie als sehr interessant, da es deutlich besser als die Wellenform zeigt, was da in einem Segment der Tonspur eigentlich los ist.

Was ist RX?

Der Denkansatz hinter RX ist, einen technischen Vorgang in einen kreativen zu wandeln. Hä? Hinter der Aussage stehen für mich 3 Kernelemente.

- Visuelles Arbeiten: Die Darstellung im Spektral-Audioeditor ermöglicht den Einsatz von Mal und Markierungswerkzeugen in direktem Bezug zu den Frequenzen

- One Klick Werkzeuge: Die auf Großrechnern per Machine Learning entstandenen Reparaturassistenten fassen einzelne Schritte in einen Klick zusammen. Die Anpassung seitens des Users mit wenigen Parametern im Dialogfeld reicht aus, um die "Wirkrichtung" festzulegen.

- Es wird nicht nur weggenommen: Ähnlich wie mit dem Reparaturpinsel in Photoshop wird intelligent Material ersetzt, um keine "schwarzen Soundlöcher" aufzureißen.

Time is Money gilt zwar nicht unbedingt für uns Hobbyisten, aber im Haupteinsatzgebiet von RX (Film und Fernsehen) zählt jede Minute. Und so gibt es auch ein Paket an Werkzeugen, die im Prinzip jeder Tonspur guttun. De-Noise (Netzbrummen und Co.), De-Click und Mouth De-Click sind dabei die GoTo Werkzeuge der Profis. Die Berechnung der Vorschau wird dabei recht zügig erledigt. (ein 5 Minuten iPhone Interview war auf meinem iMac von 2013 - 32 GB RAM - in 30 Sekunden berechnet).

Neben der Stimme wurde RX im Rahmen des Machine Learning auch beigebracht, wie einige Instrumente klingen und zu isolieren sind. Das Tool Music Rebalance erlaubt es dann diese Instrumente anzuheben oder abzusenken. Ihr werdet jetzt sagen ... "hhhmm, RX ist also ein Werkzeug um den Fehler im Mix zu beheben? Warum nicht gleich einen guten Mix anlegen?" Und richtig, liegen die Einzelspuren vor, so sollte dieses Problem gar nicht erst auftauchen. Allerdings haben wir mit unserer Band grade die Situation durchlaufen, dass wir im Rahmen einer kleinen Video Session mit fertigem Mix von der Bühne gespielt haben. Dieser war für die anwesenden Ohren auch wirklich gut, das Stereo Mikro Paar der Videokamera hat jedoch etwas anderes wahrgenommen (etwas analytisch und weitestgehend ohne Raum). Die Tonspur klang etwas ernüchternd ... Ein ähnliches Werkzeug ist auch Bestandteil von iZotope Ozone. Als "Master Relance" hat es uns bei der Pegelkorrektur von Drums, Vocals und Bass innerhalb des fertigen Mix gute Dienste geleistet. Es arbeitet dort in Echtzeit und kann automatisiert werden. (P.S. Zu Ozone plane ich einen weiteren Newbee Thread).

Der Erstkontakt bei der Thomann Gearhead (RX7)

Mein Spieltrieb (RX9)

Durch die Möglichkeiten von iZotope Ozone neugierig geworden, habe ich mich auch an meinen RX Kontakt erinnert. Der Spieltrieb war geweckt und ich habe mir zwei Gitarrenspuren in den Looper gespielt und dann davon eine Aufnahme mit Störgeräuschen erstellt. Geklappert, gehustet und einiges mehr. Jetzt wollte ich wissen, wie weit ich diese Störgeräusche wieder entfernen kann. Wie ich recht schnell bemerkt habe, hatte ich zumindest einen kleinen Vorteil durch die Verwendung eines Guitar Cabinets als Quelle. Alle Störgeräusche hatten Obertöne, die über dem Gitarrensignal angesiedelt waren. In der bildlichen Darstellung konnte ich so zumindest die Stellen sehr gut identifizieren. Aber auch die Störungen waren - weil intensiver als das Hauptmaterial recht gut zu sehen. Durch die viele Energie an genau einer Stelle, springen sie einem fast ins Auge.

Anmerkung:

blau - die normale Wave Form

orange - zeigt die Energieverteilung nach Frequenzen. Unten die tiefen Frequenzen, oben die hohen Frequenzen. Je heller - desto mehr Energie

Für die weiter Betrachtung schalte ich das Wave-Overlay aus. Aber bereits hier sieht man gut, dass nur meine beiden Störgeräusche - mit denen ich mich zuerst befassen will - oben herum "Energie" produzieren.

Fehler #1 - die Klicks

Hier das Missgeschick ... zwar im Takt, aber trotzdem fehl am Platz. P.S. Störgeräusche die im Takt liegen, sind oft etwas schwerer zu erreichen.

Mehr Probleme hatte ich beim Markieren die Stellen so zu erwischen, dass ich auch alles ausgeblendet bekomme. Wie sich im Nachgang rausstellte, habe ich zu wenig Fleisch gelassen und mich zu sehr auf die Teilbereiche hoher Intensität beschränkt. Das hatte zur Folge, dass zwar das Hauptgeräusch entfernt war, der hörbare Eindruck eines "klicks" jedoch noch zu erkennen war. So, als hätte ich die Schatten nicht "(v)erwischt". Ein zweites Thema bei meinem Trial & Error war, dass ich jeweils versucht habe, mit einem Durchgang zu arbeiten. Im Dialog mit Jürgen (oben aus dem Video) hat er mir mit seiner Herangehensweise eine Variante gezeigt, die auf mehreren Schichten basiert, in denen das fehlerhafte Material abgetragen wird und gleichzeitig aus der Umgebung der Markierung Ersatz hinzugefügt wird.

Wie man hier sehen kann, habe ich den Grundton des Klicks gut gefunden und über die RX Software - ähnlich wie beim Pfeifen im Beispiel des Gearhead Videos - die Obertöne dazu anzeigen lassen. Wie bereits erwähnt, hat dieser Weg zwar Wirkung gezeigt, aber nicht abschließend dazu geführt den Klick komplett zu entfernen.

Jürgen hat dann empfohlen etwas großzügiger zu markieren (entweder so filigran wie hier, oder über ein Rechteck der kompletten Stelle ab dem Grundton des Klicks.) Da im Werkzeug "Spectral Repair" sowieso ein Parameter für die "Surrounding region lenght" angelegt werden kann, schaut die Software auch ausserhalb der Markierung. Innerhalb der Markierung kann man mit "Strenght" wählen ab welcher Schwelle die Reparatur zur Anwendung kommt.

Durch eine Kombination aus "Attenuate" (Absenkung des gewählten Materiales) und "Replace" (Ersetzung des gewählten Materiales) sind wir der Aufgabe #1 Herr geworden und haben die beiden Klicks aus dem Track entfernen können. Geschätzter Zeitaufwand von Datei öffnen, Stelle finden, markieren, ein wenig probieren und Ergebnis exportieren - ohne erklärendes Gelaber, wenn man das Programm beherrscht - unter 3 min.

Hier nun das Ergebnis dieser Stelle in der Schnellbearbeitung ...

Fehler #2 - Husten, we have a problem

War ja klar, der stört auch noch an einer Stelle. Hier erst mal der entsprechende Ausschnitt. Befasst haben wir uns mit der ersten Hälfte. Wenn ihr hinhört, klingt mein Hustenanfall wie 2 Silben.

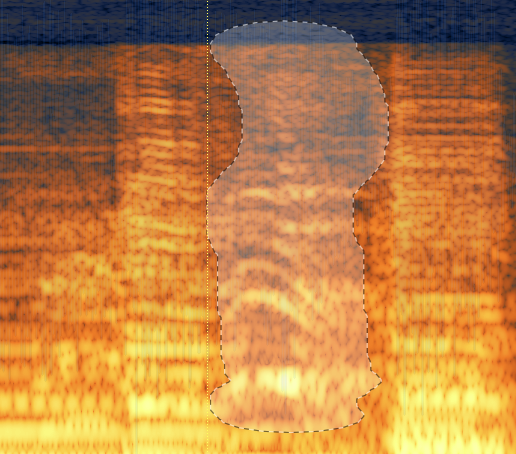

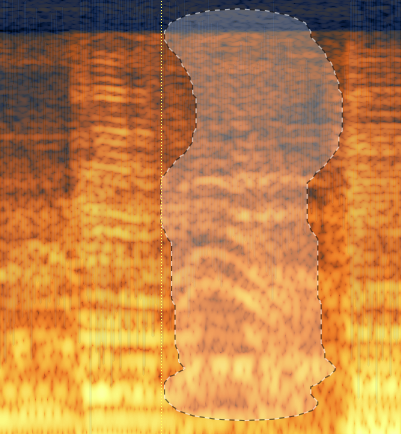

Das sieht dann in der Heatmap so aus ...

Die Teile oben lassen sich recht einfach beschneiden, aber so ein Husten sitzt ja bekanntlich tief. Daher gibt es auch innerhalb der "Nutzinformation" was anzufassen. Ganz leicht ist es nicht den komplett weg zu bekommen, aber zumindest soweit gedämpft, dass er nicht mehr auffällt.

Als Werkzeuge waren wieder Attenuate und Replace am Start.

Bitte beachtet, wie der untere helle Fleck an "Wucht" verliert ...

Diesmal erkennt man es sogar in der WAVE Form, der die Spitze der "ersten Silbe" gekappt wurde. (Siehe Markierung im Vergleich zur oberen Spur die korrigiert ist).

Hier also das Soundschnipsel ohne den ersten Teil des Hustens.

Fehler #3 Klatschen

Vom Pegel in der WAVE-Form passte das Klatschen ganz gut zur restlichen Information, daher ist auch kein wesentlicher Unterschied vorher/nachher zu sehen. Es passierte in der markierten Stelle.

Auch hier gab es wieder etwas mehr zu markieren und besonders in diesem Fall wurde auch nicht alles in einem "Rutsch" gemacht.

Fehler #4 Reverb auf Interviewstimme

Dies ein Beispiel welches iZotope mal vorbereitet hatte. Es ist Teil des Pressepaket.

Vorher

Nach der Korrektur ...

Fehler #5 De-Click

Wieder basierend auf einer WAV Datei von iZotope habe ich diesmal selbst probiert was im De-Click Werkzeug drin steckt. Bei dieser Aufnahme hat sich ein recht konstantes Klicken im Hintergrund eingeschlichen. Man hört es nicht direkt prominent, aber wehe man hat es mal gehört

So habe ich es probiert. Bei noch weiter erhöhter Sensitivity sagt mein Ohr "Stop", denn dann klingen auch die Vocals verwaschen. Was auch eine interessante Option ist um rauszuhören ob man tatsächlich die Störgeräusche erwischt, die man erwischen möchte, ist die Schalterstellung "Output Clicks Only". Also im Prinzip die Umkehrung - je natürlicher die Klicks hier klingen, umso besser werden sie in der Zieldatei weggelassen.

Klingt dann so.

Fazit

Es ist erstaunlich, was man an Störfaktoren aus Dateien entfernen kann. Natürlich sollte dies kein Freibrief sein, um sich bei der Aufnahme nicht mehr zu bemühen, denn zumindest als Anfänger muss man Zeit und Ausdauer zur Korrektur mitbringen. Es gibt aber wohl auch Vollprofis die an der Supermarktkasse in Bezug auf ein Bild des Geschehens mal schnell eine Reparaturkette vorschlagen. Grundsätzlich ist die Art der Visualisierung wirklich der Problemlösung förderlich. P.S. bei der Erstellung des Lava-Lampen Sounds mit Moogmann war ich das erste mal dabei, wie sich jemand rein "optisch" durch einen Soundfile bewegt und dabei passende Schnitte erledigt hat.

Auch mir gefällt mir der optische Zugang zum Material besonders gut. Was ich abschwächen muss wird so für mich deutlich intuitiver und ich brauche kein "Frequenz-Rate-Spiel" machen um zu erkennen was betroffen ist. Die vorbereiteten Werkzeuge laden zum experimentieren ein und sind sehr verständlich in der Bedienung.

In Summe war die Zeit - mit der ich mich mit dem Werkzeug beschäftigt habe - viel zu kurz, um auch nur im Ansatz den Sprung weg vom oben erwähnten Newbee zu schaffen. Da gibt es noch einiges zu lernen und auszuprobieren. Der Erfolg an den kleinen Beispielen macht aber Mut dran zu bleiben.

Primär ging es mir beim Testrun jedoch nicht darum Fachmann zu werden, sondern die Neugierde rauszufinden was als Noob überhaupt geht, war die Triebfeder.

...

...Wenn euch der Thread neugierig gemacht hat, oder ihr bereits mehr Erfahrung mit RX besitzt, würde ich mich über kleine Berichte oder HowTo's freuen. Screenshoot der Problemstelle, vorher/nachher mp3 und ein wenig Info zu den eingesetzten Mittel aus dem RX Werkzeugkasten sind sicher wertvolle Information für Nachahmer ... Los gehts

EDIT - natürlich sind auch Video Tutorial Fundstücke gerne gesehen. Da ich ja in meinen Interview Situationen viel mit den typischen Podcaster Problemen zu tun habe, fand ich dieses Video (noch in Bezug auf RX8) recht spannend, da es einen Großteil der Probleme in die ich regelmäßig reinlaufe adressiert.

Gruß

Martin

- Eigenschaft

Zuletzt bearbeitet: