K

knotenpunkt

Registrierter Benutzer

- Zuletzt hier

- 09.06.20

- Registriert

- 15.11.15

- Beiträge

- 21

- Kekse

- 0

Hey,

ich habe ein paar Allgemeine Frage zum Thema Mischpult. Ich werde zwar das Behringer ddx16 32 referenzieren und teilweise sogar wirklich nicht übertragbare Fragen zu diesem Pult stellen.

Das meiste wird aber generisch übertragbar für alle "Mixer" stehen.

Das Manual vom DDX1632: https://drive.google.com/file/d/0B6bQnKB7VzeoNGt2ZnhXaF94NlE/view Auf Seite 5 ist ein Blockschaltbild zu sehen.....

Die 1. Frage:

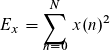

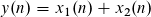

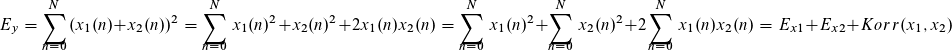

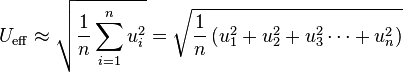

Wie berechne ich den Zielwert an db, wenn ich zwei channel merge, also die Summe davon? (kann dies sogar von mischpult zu mischpult anders sein, summe, mittelwert, etc?)

Wie berechne ich den Zielwert an db, wenn ich X channel merge?

Wo in der Verarbeitungskette den EQ, Comp, etc schalten?, Ich könnte ja jetzt direkt auf jeden Channel den EQ, etc schalten, oder aber channel in einem Bus zusammenfassen und auf den dann durch "nen Trick" beim DDX1632 auch EQ, etc darauf schalten.

Macht des einen Unterschied, wenn ich auf CH1 und CH2 einen EQ mit identischen Einstellungen schalte, oder ob ich auf die Summe den EQ mit identischen Einstellungen gebe?

Was spricht technisch, musikalisch für den einen bzw. für den anderen Weg?

Und nun eine konkrete Frage zu ddx1632:

Das Mischpult hat ja Busse. Welchen Sinn verfolgte Behringer, dass man bspw. CH1. auf verschiedene Busse routen kann, ABER nur einmal den Fader, bzw. gain hierfür einstellen kann?

Bspw. möchte ich CH1 auf Bus1 und Bus5 legen, aber mit unterschiedlichem Verhältnis, da ich unterschiedliche Summen auf Bus1 und Bus5 haben möchte (also wenn ich jetzt noch weitere CH darauf route)

Geht aber wohl nicht? Warum? (zuviel Rechenzeit um ein bisschen die pegel unterschiedlich anzupassen, oder ist das ddx1632 nicht wirklich digital?)

So kann ich mit den Bussen eigentlich nicht viel anfangen....

Ich kann mehrere Master-Busse generieren, aber nicht gleichzeitig ein anderes Bus-System aufbauen, das auf nen digitalen out geht oder etc.

Also was ich nicht wirklich verstehe ist, dass ich zwar nen CH auf unterschiedliche Busse legen kann, aber nicht unterschiedliche eingangspegel definieren kann. So macht für mich die Funktionalität, dass ich auf unterschiedliche busse routen kann auch nicht mehr wirklich Sinn, also warum?

Bzw. konkret gefragt, was bringt mir die Funktionalität, dass ich auf unterschiedliche busse routen kann, ohne verhältniseinstellungen?, was kann ich damit anfangen? Worin besteht der Mehrwert, dass ich nur den einen Teil dieser Funktionalität habe.

Nächste Frage.... interne Delay-Zeiten:

Ich habe vorhin von einem Trick gesprochen. Ich kann die Busse zurück auf die Inputs 17-32 legen.

Damit kann ich EQ und etc auch nochmal für die Summe der Busse einstellen.

Jetzt hat mich aber jemand davor gewarnt. Wenn ich jetzt von CH1 auf master out gehe und CH1 auf einen Bus route, diesen dann bspw. auf input 17 zeigen lasse und hierauf bspw. wieder nen EQ definiere und anschließend auch auf master out gehe, dass ich dann eventuell unterschiedliche laufzeiten habe.

Aber auch generell AUX wege, send-effekte.... wie garantiere ich dass ich am ende mit gleichen laufzeiten die digitalen, aber auch physikalischen outputs mit dem entsprechenden siginal verlasse. Garantiert mir das das mischpult selber, oder muss ich da selber Hand anlegen, oder ist es normal, dass ich auf den aux-wegen andere outs habe wie auf den master-outs (auf die laufzeit bezogen)

Außerdem kann ich ja bei dem pult bspw. die dynamics je CHannel anschalten oder by-passen.... kann es auch hier schon zwischen den channeln ohne komplexes routing zu laufzeitdifferenzen kommen?

Auf was muss man da alles achten, muss ich sowas mit den delay-funktionenen angleichen?

Falls ich sowas angleichen müsste, muss ich ja erstmal wissen, welche Delay-Zeiten intern entstehen, wo wir auch schon beim nächstem Thema sind.

Software:

Mit welcher Software, kann ich zumindest die Differenz zwischen Eingang und Ausgang des Pults messen (Linux, Windows)

- relativ Laufzeitunterschiede zwischen verschiedenen inputs und outputs und mischungsszenarien

-absolute Differnez.... heisst ich muss vorher die Rechner, Soundkartelaufzeit von meinem PC irgendwie herausrechnen

gibts da irgendwelche gute Software und best practise anwendungen

Wieviel geamt delay ist noch angemessen?

Software-Einmessen:

Hab mir mal näher die Software http://www.voxengo.com/product/span/ als Cubase-Plugin angesehen.

Was denkt ihr dazu?

Wie misst man damit am besten ein. Pink Noise Signal vom PC aufs Pult geben und mit Mess Mikro einfangen.

Und dann am EQ vom Pult rumschrauben

Jetzt muss ich aber wieder auf Laufzeiten achten. Delay anpassen oder?

Wie kann ich des Tool einsetzen um einzelnen Channel zu analysieren, was bringt mir die Analyse und etc?

Gibts da bessere Tools, Features?

Welche weitere Analysesoftware würdet ihr empfehlen?

Ein weiteres Szenario:

Das ddx1632 hat leider keinen 32 Band EQ.... ich hab mir gedacht naja ich pushe des ganze via adat in ein focusrite interface (leider nur usb und kein firewire zum pc), dann in cubase dann in EQ (eventuell auch noch multiband-comp) und dann das ganze wieder zurück, oder am besten gleich über out von focusrite, da hier ja die DA-Wandler einiges besser sind^^

Problemfeld hier ist mal wieder der Delay^^

Naja allgemein wie seht ihr des, dass man heutzutage eher mit dem PC mixed?, also wirklich alles in den Computer hineinroutet und hier dann mixed?

Wie könnte ich den Delay in Griff bekommen, bzw. ist er sogar vertretbar?

Wie kann ich den Delay weiter reduzieren? Cubase meiden?,einen Linuxechtzeitkernel verwenden, andere USB-Driver, firewire?, etc.....

Was ist wenn ich Delay X akzeptieren kann und nur partiell Dinge über den Computer verarbeiten möchte, bspw. den Multiband-Comp auf eine bestimmte Bus-Spur,

dann muss ich doch den delay von ALLEN anderem anpassen, da ich ja keinen negativ-Delay einstellen kann....

Das Pult selber hat zwar keinen 32 Band-Eq aber neben der dynamic-section (beinhaltet einen 4eq je spur) noch einen 8band eq in der effekt-section.

Ich würde jetzt das endsignal (vermutlich von einem buss, dass ich wieder zurückgeroutet auf bspw. ch17 habe) auschließlich als send-route in FX4 (das den 8 eq beinhaltet) routen und diesen dann schließlich als einzigsten auf den Output legen. Ist das ne gute practise so? Ich habe generell irgendwie das mulmige Gefühl je anspruchsvoller ich das Routing gestalte und Funktionen (hier als Effekt der 8 Band eq) reinhaue, desto schlechter wird das singal, desto größer die Delay Zeiten und desto unberechenbarer das ganze....

Ein Fallbeispiel, wie ich eine möglichst flexibel das Mischpult einstellen würde

Naja ich würde bspw. wenn ich nur 16 channel benötigen würde, diese auf 8 Busse mischen, also vom Verhältnis her (und eventuell auch schon etwas von der Dynamic-Section her)

Diese 8 Busse würde ich auf Channel 17-25 zurückrouten. Hier kann ich dann nochmal mit der Dynmic-Section, Effekt-Section, Aux-Section arbeiten. Auch könnte ich hier das ganze (den gruppierten Mix) nochmal auf ein Bus-System legen (nicht auf die gleichen Busse, da sonst interne Rückkopplungen entstehen würden^^)

Auf CH17-25 würde ich dann die eigentliche Arbeit an Dynamic-Sektion machen, bspw. den gesamten Gesang auf einmal mit nem EQ bearbeiten.... also bspw. CH1-8 ist gesang -> 1-4 lege ich auf BUS1 und 5-8 auf BUS2 (entspricht dann CH17 +CH18).... CH17+CH18 würde ich dann auf BUS3 legen (entspricht dann CH19) Jetzt kann ich in allen 3 Hirachiestufen die Dynamics und Effekte anpassen. Hierachiestufe1: CH1-8.... Hierachiestufe2: CH17+CH18.... Hierachiestufe3 CH19. Auch kann ich aus allen hierachiestufen aux abzweigen.

Problem hierbei ist mal wieder, dass ich vermutlich innerhalb einer Hirachiestufe kleine Verzögerungen habe, bedingt durch die Anzahl der in dieser Hirachiestufe arbeitende Funktionen (EQ, Comp, etc) und vermutlich habe ich DRASTISCHE Unterschiede zwischen den Hirachiestufen????!!??.... stimmt das so?

Ok wenn ich jetzt auf dem Main-Out nur die letzte Hirachiestufe abgreife und die gesamtverzögerung in kauf nehmen kann, dann passt des (wie aber berechnet sich der gesamtdelay?)

Aber möchte ich jetzt bspw. die Monitor-Boxen via Aux-Wege versorgen und bspw. gefallen mir die Männerstimmen gesamt -> hirachiestufe2: CH18, wobei CH18 dann den männergesang repräsentiert -> AUX1

Die Frauen möchte ich aber nicht genauso wie ich se im Bus1 bzw. CH17 zusammengefasst habe so auf den monitor geben, also gehe ich in die hirachiestufe1: und mach mir aus den CH1-4 nen eigenen mix und lege alle direkt auf AUX1

Und Bähm ich habe unterschiedliche Laufzeiten

Jetzt könnte ich alle Frauenstimmen CH1-4 mit nem output delay auf AUX1 belegen. Aber das ist - glaube ich - gar nicht möglich, also funktioniert das so schon mal gar nicht.

Ich könnte auch nen weiteren Bus dafür verschwenden, geht aber auch nicht, da ich ja hier keine unterschiedlichen pegel einstellen kann, funktioniert also auch nicht

Ein weiteres Problem ist eine zusätzliche Aufnahme.

Ich könnte jetzt bspw. Hirachiestufe 2 gleichzeitig digital abnehmen, das geht!

Aber möchte ich jetzt für die Aufnahme ein anderes Mischungsverhältnis, dann geht das nur eingeschränkt bis gar nicht.

ich könnte die Busse 9-16 noch dafür verwenden. Da kann ich die Spuren auch drauf routen, ABER wie man ja oben gesehen hat kann ich hier keine anderen pegeleinstellungen wählen, wie ich schon für die ersten 8 Busspuren verwendet habe..... Bähm geht also auch nicht wirklich!

Naja mal abgesehen von der Aufnahme, eigentlich ist es schon so, dass man Spuren gruppieren möchte und dann auf die Gruppierung einen Effekt haut, oder?

Wie aber realisiert man das gescheit, auf was muss man da alles achten, oder sollte ich das mit dem Gruppieren lassen und doch wieder nur auf einer Hirachiestufe arbeiten?

Welche Zeitgarantien muss das Mischpult liefern? Wieviel delay ist zwischen zwei signalen vertretbar?

Wie kann ich des abschätzen/ausrechnen, was konkret passiert, wenn ich so oder so route?

wie kann ich das dann auch konkret messen via pc?

Was ist best-pracise, das ganze aufzuziehen?

Wo muss ich richtig aufpassen?

Man sagt ja weniger ist mehr.... dann bräuchte ich aber kein Digi-Mischpult mit Bussen und etc....

Abschließend gehe ich mal aus dem diskreten Bereich heraus und komme noch zu was kontinuirlichem

Das mischpult hat ja unterschiedliche line-pegel..... muss ich aufpassen, wenn ich nen main-out auf ein line-in eines anderen pults lege, oder reicht es aus den fader ziemlich weit unten zu lassen, oder kann auch schon das gefährlich sein?

Kann ich das Mischpult irgendwie mit meiner HeimStereoanlage (sind Cinch-eingänge) verbinden bspw. um die monitorbeschallung weiter auszubauen.... muss ich da auf was konkretes achten? Oder ist auch das ziemlich gefährlich, also für die Heimstereoanlage?^^

Naja das wars erst mal an Fragen, vermutlich hab ich ziemlich viel vergessen zu fragen, aber das schiebe ich bei gelegenheit nach^^

Zusammenfassend geht es darum, wie man Dinge ausrechnet, was passiert wenn ich so oder so route, wie da die Delay-Zeiten sind, ob man wirklich so kompliziert routen sollte bzw. überhaupt darf, wegen delay....

Welche Software ist gut zum Einmessen, analysieren, delay-zeiten messen

Was sind so die best-pracisen beim routen und etc....

Noch kurz etwas offtopic:

Noch ne andere Frage, hat zufällig noch jemand ein aktuelles Firmware update vom ddx1632 herumliegen.

gibts zufällig eine source-code veröffentlichung bzw. ist es erlaubt via reverse-engineering in der firmware herumzuspielen (wobei der sourcode wäre mir lieber^^)

Weiß jemand wie man die Channel-Meter(also die LED anzeige) via midi sysex übertragen lassen kann?

lg knotenpunkt

ich habe ein paar Allgemeine Frage zum Thema Mischpult. Ich werde zwar das Behringer ddx16 32 referenzieren und teilweise sogar wirklich nicht übertragbare Fragen zu diesem Pult stellen.

Das meiste wird aber generisch übertragbar für alle "Mixer" stehen.

Das Manual vom DDX1632: https://drive.google.com/file/d/0B6bQnKB7VzeoNGt2ZnhXaF94NlE/view Auf Seite 5 ist ein Blockschaltbild zu sehen.....

Die 1. Frage:

Wie berechne ich den Zielwert an db, wenn ich zwei channel merge, also die Summe davon? (kann dies sogar von mischpult zu mischpult anders sein, summe, mittelwert, etc?)

Wie berechne ich den Zielwert an db, wenn ich X channel merge?

Wo in der Verarbeitungskette den EQ, Comp, etc schalten?, Ich könnte ja jetzt direkt auf jeden Channel den EQ, etc schalten, oder aber channel in einem Bus zusammenfassen und auf den dann durch "nen Trick" beim DDX1632 auch EQ, etc darauf schalten.

Macht des einen Unterschied, wenn ich auf CH1 und CH2 einen EQ mit identischen Einstellungen schalte, oder ob ich auf die Summe den EQ mit identischen Einstellungen gebe?

Was spricht technisch, musikalisch für den einen bzw. für den anderen Weg?

Und nun eine konkrete Frage zu ddx1632:

Das Mischpult hat ja Busse. Welchen Sinn verfolgte Behringer, dass man bspw. CH1. auf verschiedene Busse routen kann, ABER nur einmal den Fader, bzw. gain hierfür einstellen kann?

Bspw. möchte ich CH1 auf Bus1 und Bus5 legen, aber mit unterschiedlichem Verhältnis, da ich unterschiedliche Summen auf Bus1 und Bus5 haben möchte (also wenn ich jetzt noch weitere CH darauf route)

Geht aber wohl nicht? Warum? (zuviel Rechenzeit um ein bisschen die pegel unterschiedlich anzupassen, oder ist das ddx1632 nicht wirklich digital?)

So kann ich mit den Bussen eigentlich nicht viel anfangen....

Ich kann mehrere Master-Busse generieren, aber nicht gleichzeitig ein anderes Bus-System aufbauen, das auf nen digitalen out geht oder etc.

Also was ich nicht wirklich verstehe ist, dass ich zwar nen CH auf unterschiedliche Busse legen kann, aber nicht unterschiedliche eingangspegel definieren kann. So macht für mich die Funktionalität, dass ich auf unterschiedliche busse routen kann auch nicht mehr wirklich Sinn, also warum?

Bzw. konkret gefragt, was bringt mir die Funktionalität, dass ich auf unterschiedliche busse routen kann, ohne verhältniseinstellungen?, was kann ich damit anfangen? Worin besteht der Mehrwert, dass ich nur den einen Teil dieser Funktionalität habe.

Nächste Frage.... interne Delay-Zeiten:

Ich habe vorhin von einem Trick gesprochen. Ich kann die Busse zurück auf die Inputs 17-32 legen.

Damit kann ich EQ und etc auch nochmal für die Summe der Busse einstellen.

Jetzt hat mich aber jemand davor gewarnt. Wenn ich jetzt von CH1 auf master out gehe und CH1 auf einen Bus route, diesen dann bspw. auf input 17 zeigen lasse und hierauf bspw. wieder nen EQ definiere und anschließend auch auf master out gehe, dass ich dann eventuell unterschiedliche laufzeiten habe.

Aber auch generell AUX wege, send-effekte.... wie garantiere ich dass ich am ende mit gleichen laufzeiten die digitalen, aber auch physikalischen outputs mit dem entsprechenden siginal verlasse. Garantiert mir das das mischpult selber, oder muss ich da selber Hand anlegen, oder ist es normal, dass ich auf den aux-wegen andere outs habe wie auf den master-outs (auf die laufzeit bezogen)

Außerdem kann ich ja bei dem pult bspw. die dynamics je CHannel anschalten oder by-passen.... kann es auch hier schon zwischen den channeln ohne komplexes routing zu laufzeitdifferenzen kommen?

Auf was muss man da alles achten, muss ich sowas mit den delay-funktionenen angleichen?

Falls ich sowas angleichen müsste, muss ich ja erstmal wissen, welche Delay-Zeiten intern entstehen, wo wir auch schon beim nächstem Thema sind.

Software:

Mit welcher Software, kann ich zumindest die Differenz zwischen Eingang und Ausgang des Pults messen (Linux, Windows)

- relativ Laufzeitunterschiede zwischen verschiedenen inputs und outputs und mischungsszenarien

-absolute Differnez.... heisst ich muss vorher die Rechner, Soundkartelaufzeit von meinem PC irgendwie herausrechnen

gibts da irgendwelche gute Software und best practise anwendungen

Wieviel geamt delay ist noch angemessen?

Software-Einmessen:

Hab mir mal näher die Software http://www.voxengo.com/product/span/ als Cubase-Plugin angesehen.

Was denkt ihr dazu?

Wie misst man damit am besten ein. Pink Noise Signal vom PC aufs Pult geben und mit Mess Mikro einfangen.

Und dann am EQ vom Pult rumschrauben

Jetzt muss ich aber wieder auf Laufzeiten achten. Delay anpassen oder?

Wie kann ich des Tool einsetzen um einzelnen Channel zu analysieren, was bringt mir die Analyse und etc?

Gibts da bessere Tools, Features?

Welche weitere Analysesoftware würdet ihr empfehlen?

Ein weiteres Szenario:

Das ddx1632 hat leider keinen 32 Band EQ.... ich hab mir gedacht naja ich pushe des ganze via adat in ein focusrite interface (leider nur usb und kein firewire zum pc), dann in cubase dann in EQ (eventuell auch noch multiband-comp) und dann das ganze wieder zurück, oder am besten gleich über out von focusrite, da hier ja die DA-Wandler einiges besser sind^^

Problemfeld hier ist mal wieder der Delay^^

Naja allgemein wie seht ihr des, dass man heutzutage eher mit dem PC mixed?, also wirklich alles in den Computer hineinroutet und hier dann mixed?

Wie könnte ich den Delay in Griff bekommen, bzw. ist er sogar vertretbar?

Wie kann ich den Delay weiter reduzieren? Cubase meiden?,einen Linuxechtzeitkernel verwenden, andere USB-Driver, firewire?, etc.....

Was ist wenn ich Delay X akzeptieren kann und nur partiell Dinge über den Computer verarbeiten möchte, bspw. den Multiband-Comp auf eine bestimmte Bus-Spur,

dann muss ich doch den delay von ALLEN anderem anpassen, da ich ja keinen negativ-Delay einstellen kann....

Das Pult selber hat zwar keinen 32 Band-Eq aber neben der dynamic-section (beinhaltet einen 4eq je spur) noch einen 8band eq in der effekt-section.

Ich würde jetzt das endsignal (vermutlich von einem buss, dass ich wieder zurückgeroutet auf bspw. ch17 habe) auschließlich als send-route in FX4 (das den 8 eq beinhaltet) routen und diesen dann schließlich als einzigsten auf den Output legen. Ist das ne gute practise so? Ich habe generell irgendwie das mulmige Gefühl je anspruchsvoller ich das Routing gestalte und Funktionen (hier als Effekt der 8 Band eq) reinhaue, desto schlechter wird das singal, desto größer die Delay Zeiten und desto unberechenbarer das ganze....

Ein Fallbeispiel, wie ich eine möglichst flexibel das Mischpult einstellen würde

Naja ich würde bspw. wenn ich nur 16 channel benötigen würde, diese auf 8 Busse mischen, also vom Verhältnis her (und eventuell auch schon etwas von der Dynamic-Section her)

Diese 8 Busse würde ich auf Channel 17-25 zurückrouten. Hier kann ich dann nochmal mit der Dynmic-Section, Effekt-Section, Aux-Section arbeiten. Auch könnte ich hier das ganze (den gruppierten Mix) nochmal auf ein Bus-System legen (nicht auf die gleichen Busse, da sonst interne Rückkopplungen entstehen würden^^)

Auf CH17-25 würde ich dann die eigentliche Arbeit an Dynamic-Sektion machen, bspw. den gesamten Gesang auf einmal mit nem EQ bearbeiten.... also bspw. CH1-8 ist gesang -> 1-4 lege ich auf BUS1 und 5-8 auf BUS2 (entspricht dann CH17 +CH18).... CH17+CH18 würde ich dann auf BUS3 legen (entspricht dann CH19) Jetzt kann ich in allen 3 Hirachiestufen die Dynamics und Effekte anpassen. Hierachiestufe1: CH1-8.... Hierachiestufe2: CH17+CH18.... Hierachiestufe3 CH19. Auch kann ich aus allen hierachiestufen aux abzweigen.

Problem hierbei ist mal wieder, dass ich vermutlich innerhalb einer Hirachiestufe kleine Verzögerungen habe, bedingt durch die Anzahl der in dieser Hirachiestufe arbeitende Funktionen (EQ, Comp, etc) und vermutlich habe ich DRASTISCHE Unterschiede zwischen den Hirachiestufen????!!??.... stimmt das so?

Ok wenn ich jetzt auf dem Main-Out nur die letzte Hirachiestufe abgreife und die gesamtverzögerung in kauf nehmen kann, dann passt des (wie aber berechnet sich der gesamtdelay?)

Aber möchte ich jetzt bspw. die Monitor-Boxen via Aux-Wege versorgen und bspw. gefallen mir die Männerstimmen gesamt -> hirachiestufe2: CH18, wobei CH18 dann den männergesang repräsentiert -> AUX1

Die Frauen möchte ich aber nicht genauso wie ich se im Bus1 bzw. CH17 zusammengefasst habe so auf den monitor geben, also gehe ich in die hirachiestufe1: und mach mir aus den CH1-4 nen eigenen mix und lege alle direkt auf AUX1

Und Bähm ich habe unterschiedliche Laufzeiten

Jetzt könnte ich alle Frauenstimmen CH1-4 mit nem output delay auf AUX1 belegen. Aber das ist - glaube ich - gar nicht möglich, also funktioniert das so schon mal gar nicht.

Ich könnte auch nen weiteren Bus dafür verschwenden, geht aber auch nicht, da ich ja hier keine unterschiedlichen pegel einstellen kann, funktioniert also auch nicht

Ein weiteres Problem ist eine zusätzliche Aufnahme.

Ich könnte jetzt bspw. Hirachiestufe 2 gleichzeitig digital abnehmen, das geht!

Aber möchte ich jetzt für die Aufnahme ein anderes Mischungsverhältnis, dann geht das nur eingeschränkt bis gar nicht.

ich könnte die Busse 9-16 noch dafür verwenden. Da kann ich die Spuren auch drauf routen, ABER wie man ja oben gesehen hat kann ich hier keine anderen pegeleinstellungen wählen, wie ich schon für die ersten 8 Busspuren verwendet habe..... Bähm geht also auch nicht wirklich!

Naja mal abgesehen von der Aufnahme, eigentlich ist es schon so, dass man Spuren gruppieren möchte und dann auf die Gruppierung einen Effekt haut, oder?

Wie aber realisiert man das gescheit, auf was muss man da alles achten, oder sollte ich das mit dem Gruppieren lassen und doch wieder nur auf einer Hirachiestufe arbeiten?

Welche Zeitgarantien muss das Mischpult liefern? Wieviel delay ist zwischen zwei signalen vertretbar?

Wie kann ich des abschätzen/ausrechnen, was konkret passiert, wenn ich so oder so route?

wie kann ich das dann auch konkret messen via pc?

Was ist best-pracise, das ganze aufzuziehen?

Wo muss ich richtig aufpassen?

Man sagt ja weniger ist mehr.... dann bräuchte ich aber kein Digi-Mischpult mit Bussen und etc....

Abschließend gehe ich mal aus dem diskreten Bereich heraus und komme noch zu was kontinuirlichem

Das mischpult hat ja unterschiedliche line-pegel..... muss ich aufpassen, wenn ich nen main-out auf ein line-in eines anderen pults lege, oder reicht es aus den fader ziemlich weit unten zu lassen, oder kann auch schon das gefährlich sein?

Kann ich das Mischpult irgendwie mit meiner HeimStereoanlage (sind Cinch-eingänge) verbinden bspw. um die monitorbeschallung weiter auszubauen.... muss ich da auf was konkretes achten? Oder ist auch das ziemlich gefährlich, also für die Heimstereoanlage?^^

Naja das wars erst mal an Fragen, vermutlich hab ich ziemlich viel vergessen zu fragen, aber das schiebe ich bei gelegenheit nach^^

Zusammenfassend geht es darum, wie man Dinge ausrechnet, was passiert wenn ich so oder so route, wie da die Delay-Zeiten sind, ob man wirklich so kompliziert routen sollte bzw. überhaupt darf, wegen delay....

Welche Software ist gut zum Einmessen, analysieren, delay-zeiten messen

Was sind so die best-pracisen beim routen und etc....

Noch kurz etwas offtopic:

Noch ne andere Frage, hat zufällig noch jemand ein aktuelles Firmware update vom ddx1632 herumliegen.

gibts zufällig eine source-code veröffentlichung bzw. ist es erlaubt via reverse-engineering in der firmware herumzuspielen (wobei der sourcode wäre mir lieber^^)

Weiß jemand wie man die Channel-Meter(also die LED anzeige) via midi sysex übertragen lassen kann?

lg knotenpunkt

- Eigenschaft